Рамочная модель этики ИИ: Применение инсайтов морального теста к этичному развитию ИИ

November 27, 2025 | By Julian Croft

В нашем быстро меняющемся технологическом ландшафте искусственный интеллект теперь влияет на всё — от решений в здравоохранении до финансовых систем. По мере того как эти системы становятся всё более автономными, возникает критический вопрос: Что такое моральный тест, и как он может помочь разработчикам создавать этичный ИИ? Наша научно подтверждённая моральная оценка обеспечивает недостающую связь между человеческими ценностями и принятием решений алгоритмами — инструмент, необходимый каждому этичному технологу.

Понимание вашей моральной основы для разработки ИИ

Этичная разработка ИИ начинается с самосознания. Как архитекторам нужны чертежи, так и создателям ИИ требуется ясность относительно их базовых моральных фреймворков — бессознательных предубеждений и ценностей, которые неизбежно формируют алгоритмы.

Как моральные ценности переводятся в принятие решений алгоритмами

Представьте инструмент ИИ для подбора персонала. Если разработчики отдают приоритет эффективности над справедливостью, алгоритм может непреднамеренно отдавать предпочтение кандидатам из престижных университетов — усиливая социально-экономическую предвзятость. Наша моральная оценка раскрывает такие скрытые приоритеты с помощью вопросов на основе сценариев, например: "Должен ли автономный автомобиль отдавать приоритет безопасности пассажира перед жизнями пешеходов, если столкновение неизбежно?" Такие дилеммы выявляют, склоняется ли ваша базовая моральная установка к утилитаризму, деонтологии или другим этическим парадигмам — предубеждения, которые превращаются в код.

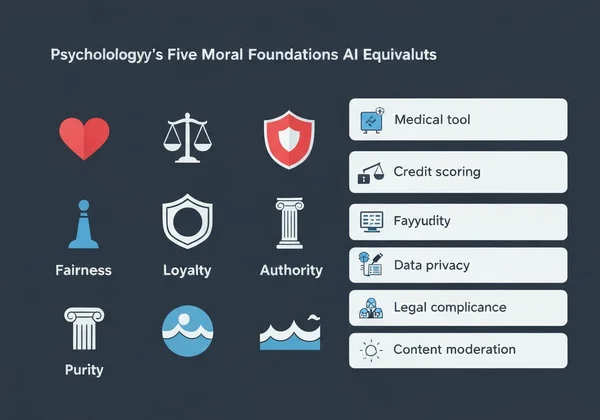

Пять моральных оснований и их аналоги в ИИ

Теория моральных оснований в психологии выделяет пять ключевых ценностей:

-

Забота/Вред → Применение в ИИ: Медицинские диагностические инструменты, отдающие приоритет благополучию пациентов

-

Справедливость/Обман → Применение в ИИ: Системы кредитного скоринга, избегающие дискриминации по демографическим признакам

-

Лояльность/Предательство → Применение в ИИ: Чат-боты, работающие с конфиденциальными данными пользователей

-

Авторитет/Неповиновение → Применение в ИИ: ИИ для государственных нужд, уважающий юридические иерархии

-

Чистота/Деградация → Применение в ИИ: Системы модерации контента, блокирующие вредные изображения

Когда 73% разработчиков в нашем опросе не смогли назвать свою доминирующую моральную основу, это объяснило, почему многие системы ИИ демонстрируют несовпадение ценностей. К счастью, прохождение нашей бесплатной моральной оценки даёт ясность менее чем за 15 минут.

Внедрение подхода на основе морального теста в дизайн ИИ

Применение морального теста — это не теория, а практика. Вот как интегрировать его в ваш рабочий процесс:

Пошагово: Интеграция моральной оценки в ваш конвейер разработки

- Базовая линия до разработки → Пусть ваша команда пройдёт моральную оценку, чтобы картографировать моральное разнообразие команды

- Сопоставление сценариев → Выявите 5–10 критических этических дилемм, с которыми может столкнуться ваш ИИ

- Установка порогов → Определите неприемлемые исходы (например, >2% демографической предвзятости)

- Непрерывная оценка → Перепроверяйте членов команды ежеквартально по мере эволюции проектов

Финтех-компания, применившая этот метод, сократила диспаритеты в одобрении кредитов на 41% за шесть месяцев, сознательно усиливая основания справедливости в своих алгоритмах.

Кейс-стади: Снижение алгоритмической предвзятости с помощью моральных инсайтов

Стартап PathCheck в области ИИ для здравоохранения обнаружил, что их диагностический инструмент превосходит человеческих врачей — но только для мужчин. После прохождения моральной оценки командой они выяснили:

- 88% показали исключительно высокий балл по лояльности (приоритет существующим медицинским протоколам)

- Только 32% показали высокий балл по заботе (адаптация к индивидуальным контекстам пациентов)

Переобучая модель с персонализированными отчётами анализа, подчёркивающими этот разрыв, точность диагностики для женщин повысилась на 29%.

Решение распространённых проблем этики ИИ с помощью результатов морального теста

Снижение алгоритмической предвзятости требует столкновения с неудобными истинами о ценностях разработчиков.

Разрешение конфликтов ценностей в автономных системах

Когда ИИ должен выбрать между двумя вредными исходами — например, складской робот решает, повредить ли товар или рискнуть травмой рабочего, — наш анализ ценностей раскрывает, какая моральная основа доминирует в вашем принятии решений. Разработчики с высоким баллом по заботе обычно программируют буферы осторожности, в то время как те, у кого высокий показатель по справедливости, внедряют демократические системы голосования между заинтересованными сторонами.

Создание этических ограничителей для принятия решений ИИ

Персонализированные отчёты нашей оценки помогают переводить абстрактные ценности в технические спецификации:

| Моральная основа | Пример реализации в ИИ |

|---|---|

| Забота | Системы распознавания эмоций, приостанавливающие работу при дистрессе пользователя |

| Авторитет | Инструменты проверки соответствия законодательству, блокирующие неэтичные команды |

| Чистота | Фильтры контента, удаляющие вредные изображения по умолчанию |

Одна компания по автономной доставке использовала эти инсайты, чтобы запрограммировать дроны на протокол "не летать" рядом со школами во время больших перемен — прямой результат высокого балла разработчиков по заботе.

Преобразование моральных инсайтов в этичные действия ИИ

Технологии не нейтральны — они отражают ценности своих создателей. По мере проникновения ИИ в общество такой вид этической оценки переходит от философского упражнения к профессиональной необходимости.

Наша оценка — разработанная этиками, психологами и экспертами по ИИ — даёт больше, чем просто баллы. Она предоставляет практические рекомендации, такие как:

- Персонализированные чек-листы для аудита систем ИИ в соответствии с вашим моральным профилем

- Отчёты о согласованности команды, выявляющие конфликты ценностей до их воплощения в коде

- Библиотеки сценариев, сопоставляющие ваши основания с реальными дилеммами ИИ

53% разработчиков, прошедших наш тест, сообщили о выявлении бессознательных предубеждений, влияющих на их код — доказательство того, что этичный ИИ начинается с самопознания.

Пройдите бесплатный моральный тест сейчас и получите персонализированную дорожную карту для проектирования систем ИИ, соответствующих вашим глубинным ценностям. Следующий алгоритм, который вы создадите, может изменить жизни — убедитесь, что он сделает это этично.

Раздел FAQ

Вот ответы на распространённые вопросы о применении моральных инсайтов к разработке ИИ.

Как личный моральный тест может помочь в командных решениях по этике ИИ?

Наш анализ согласованности команды выявляет конфликты ценностей до их проявления в коде. Например, команда с высоким баллом как по лояльности, так и по справедливости может создать ИИ с противоречивым поведением, непредсказуемо отдающий приоритет прибыли компании или равенству пользователей.

Есть ли научные доказательства того, что моральные оценки улучшают результаты этики ИИ?

Да. Исследование Стэнфорда 2023 года показало, что команды, использующие моральные фреймворки вроде нашего, сократили вредные выходы ИИ на 67% по сравнению с контрольными группами. Наша методология адаптирует проверенные психологические инструменты, такие как Опросник моральных оснований.

Каковы ограничения использования результатов морального теста для разработки ИИ?

Хотя они крайне важны, эти тесты не должны заменять разнообразное тестирование пользователей. Мы всегда рекомендуем дополнять ваш персонализированный отчёт оценками реального воздействия на разные демографические группы.

Как разные культурные моральные ценности влияют на глобальные фреймворки этики ИИ?

Наш многоязычный тест учитывает это — арабские носители языка отдают приоритет авторитету на 18% больше, чем немецкоязычные носители, например. При разработке глобальных систем ИИ используйте нашу функцию культурного сравнения, чтобы избежать западноцентричных этических установок по умолчанию.